现在现代人对机器能量和发展潜力的忧虑远远超过从前,难题并非科幻片或是小说构造的妖物机器永远是憎恶人类文明的,而是这些机器可能会有更广阔的视线和更强的发展潜力。

智能化讨论会的“背牛谈话”上,埃隆·特斯拉和马化腾就 AI 和人类文明的未来进行了辩论会。据了解,在今日召开的计算控制技术领域的年度盛事中国计算机讨论会(CNCC)上,“人工智慧开发的伦理边界线”也是一个重要的论坛主题。

围绕 AI、伦理、人类文明二者的关系这个热门话题,DeepTech 采访了北京大学生命医学伦理伦理科学研究中心、北京大学应用伦理伦理学科学研究中心主任帝国豫教授。她出席 CNCC 讨论会并增添了《人工智慧伦理伦理:从几率推断迈向可行性科学研究积极探索》的演说报告。

帝国豫从三个方面进行了对人工智慧伦理伦理的看法:人工智慧为什么是伦理的科学研究对象?人工智慧伦理伦理科学研究的方向、人工智慧的伦理伦理难题的协作环境治理。她指出,人工智慧伦理伦理源于现代人对人工智慧控制技术风险的恐惧和忧虑,人工智慧的伦理伦理难题并非单个的控制技术难题,也并非演算法难题,而是源于控制技术控制系统和人的社会生活控制系统的相互作用,人工智慧伦理伦理如果从几率推断迈向可行性科学研究积极探索。

“人工智慧一旦获得了心智是否会‘从奴隶到将军’?我真的如果我们不早作准备,理论上从人对机器的敏感性角度来看是有可能的”,帝国豫指出,“人工智慧伦理伦理难题的环境治理,既更为重要是伦理政治学家的事,也更为重要是科学家和技师的事,需要更多地交叉学科的合作。”

以下为访谈内容:

DeepTech:你一直著眼于控制技术伦理伦理学的相关难题,如果缔造了很多新经济控制技术的兴起过程以及与之相随而生的伦理伦理难题。所以你真的人工智慧的伦理伦理难题相比于其它控制技术的伦理伦理难题有什么特定性?

帝国豫:我以为,人工智慧譬如其本身特定的伦理伦理难题,又有其它新经济控制技术中国共产党有的是一些伦理伦理问,是推动第三代产业革命的关键CX600X控制技术(enabling technology)。人工智慧要破冰,必须和其它控制技术相紧密结合,比如人工智慧与汽车制造紧密结合,造成了自动驾驶或超高速控制技术;和信息处理、遥感技术、机械制造等控制技术紧密结合造成了智能化机器;和医疗控制技术紧密结合造成了智能化用药控制技术等等。目前人工智慧的核心演算法强烈倚赖数据驱动,可以说没有大数据控制技术就没有当前的人工智慧控制技术。因此,某种程度上说,人工智慧控制技术是一种高级的控制整体性控制技术或是控制技术控制系统。

从这个定义出发,所以我们就可以说,人工智慧的伦理伦理难题也并非单一的。它譬如由于控制技术较高的控制能力所增添的特定伦理伦理难题,比如说演算法伦理伦理难题,又有其它新经济控制技术中国共产党有的是伦理伦理难题,比如说隐私难题、责任归属难题等。演算法与其它控制技术一样具有价值负载,在演算法设计中选择什么参数、优先考虑哪些价值和利益,与设计者的伦理敏感性和价值取向有很大的相关性。但与此同时,演算法又会放大甚至有可能根据自身的逻辑运算作出抉择。设计者并不能完全主宰演算法的运行,也不可能预测更不能保证演算法结果在伦理上是可接受的。这也是目前争议比较大的智能化主体是否可以看作是伦理主体的难题。这个难题将随着演算法能力的增强愈加突出,也影响着责任的归属和认定。

比如说,当前讨论比较多的自动驾驶如果撞了人,谁该为事故负责任的难题。这与一般的责任认定就不完全一样,因为这里涉及到一方面自动驾驶汽车具有能动性、控制能力,方向盘和刹车掌握在智能化机器手中;但另一方面,自动驾驶汽车本身又并非伦理主体,不可能承担伦理责任。于是,我们就要追问谁该为事故负责?是设计者还是自动驾驶车辆的拥有者?是技师的责任、企业的责任,还是政府和管理工作者的责任?这些都与人工智慧的特定性相关,但这个难题同时又涉及更一般性的控制技术伦理伦理难题:控制技术伦理伦理学如何面对控制技术的不确定性,或是说我们如何与控制技术的不确定性交往的难题。

图 | 38 岁的 Walter Huang 使用特斯拉的DeepTech:你怎么看“人工智慧机器造成心智之后,机器将统治人类文明”这个观点?你真的为什么现在大家对这个难题忧虑感和恐惧感要远远超过以前?

帝国豫:这个难题的前一半是一个假设,即假设人工智慧机器将会造成心智,后一半是推断,推断“机器将统治人类文明”。这是一个典型的“If and then”的推断性论断。这使我想起捷克作家卡雷尔 • 恰佩克的《罗素姆的万能机器》中的情节。大家所熟知的机器 Robot 一词便源于该剧。Robot 这个词由捷克文 Robota 和波兰文 Robotnik 紧密结合而来,前者为“劳役、苦工”之意,后者为“工人”之意,合起来就被翻译为“被奴役的工人、奴隶”。剧中的机器一开始还没有意识、没有感觉,他们替代了人类文明的一切劳动。后来机器工厂里的一位技师悄悄给机器“注入”了“灵魂”,让机器具有了感知痛苦的能力,随后逐渐有了心智。不幸的是,机器觉醒后的第一个念头就是反抗和攻击。这可能是最早的关于机器统治人类文明的科幻文学作品,后来类似的作品越来越多。这样一种叙事带给现代人的自然是对于人工智慧的恐惧和忧虑。

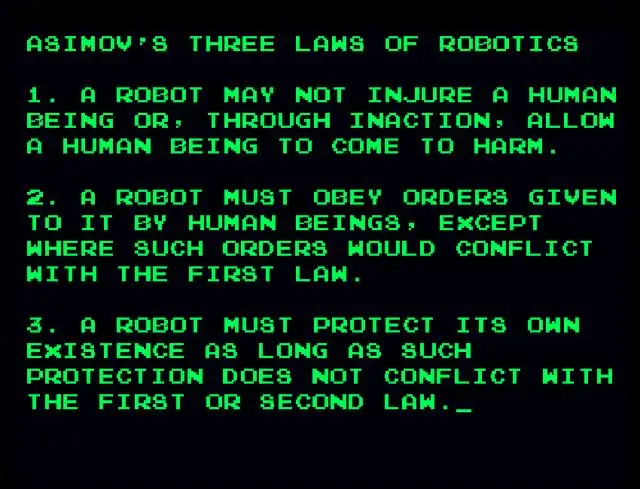

技术伦理伦理缘于现代人对控制技术的恐惧和忧虑。所以,半个多世纪以前,艾萨克•阿西莫夫就提出需要用伦理伦理规则来引导机器工智慧的行为:即机器不得伤害人类文明,或因不作为(袖手旁观)使人类文明受到伤害;除非违背第一法则,机器人必须服从人类文明的命令;在不违背第一及第二法则下,机器必须保护自己。机器不得伤害人类文明这族群,或因不作为(袖手旁观)使人类文明这族群受到伤害。(第零法则,1985)

图 | 机器三定律是艾萨克·阿西莫夫在 1942 年发表的作品《转圈圈》中第一次提出的概念,并且成为他很多小说中机器的行为准则和故事发展的线索。机器被要求要遵守这些准则,违反准则会导致机器受到不可恢复的心理损坏。之后,其它作者的科幻

所以,人工智慧机器有没有可能获得心智呢?主张强人工智慧的人指出是一定的,只不过是时间难题,库兹维尔就预言在 2045 年人与机器将深度融合,人工智慧将超过人类文明本身,达到“奇点”。我不知道人工智慧是否一定会造成心智,人类文明是否一定乐意看到或是说允许人工智慧产生心智,以及什么时候人工智慧将造成心智,这些我都无法预测,但人工智慧一旦获得了心智是否会“从奴隶到将军”?我真的如果我们不早作准备,理论上是有可能的。当然,我并并非像科幻小说家那样设想一个由机器统治的国家。而是从人的控制能力和自由的丧失的角度来看。

事实上,我们今天已经感受到了人工智慧在增强人的能力和行为自由的同时,使得人越来越倚赖它,这种敏感性也可以解释为人的独立性的丧失。就像黑格尔在《精神现象学》一书中谈到“主人和奴隶”关系时所指出的那样,主人和奴隶彼此被对方定义:一方面,主人因为奴隶的存在而成为主人,另一方面,一旦获得了统治者身份,主人得到的并并非独立意识而是依赖意识,他没有因此而确定他真实的自我,反而促使奴隶超越了主人。举个通俗的例子吧,比如我们今天所使用的智能化导航,使得我们可以安全地避开和绕过各种路况不佳的大路,我们会按照它所指引的路线到达目的地。在这个意义上它是一种赋能控制技术。我们相信这些信息来自于一个实时掌握一切动态的导航,导航对路上的一切了如指掌。但只要我们担心放弃信息会绕路,并相信接受信息便可以很快到达目的地,所以我们就开始依赖信息,这时,信息对人的“控制力”便显现出来。

关于后一个难题:为什么公众对这个难题的忧虑感和恐惧感要远远超过以前?我想首先这是因为近几年人工智慧本身的飞速发展,使得现代人已经强烈地感受到了人工智慧控制技术控制系统对我们生活世界的改变。特别是 2016 年 3 月 AlphaGo 战胜了人类文明围棋选手李世石以后,现代人在惊奇于人工智慧的强大的同时,一面是欢呼,一面是惊恐和忧虑它将如何改变世界、改变我们的生活。而一些像霍金、比尔·盖茨、特斯拉这样的名人对人工智慧的威胁的预测,也会加剧现代人的恐慌。比如霍金就指出,“一旦机器达到能够自我进化的关键阶段,我们无法预测它们的目标是否还与人类文明相同”。还有些媒体经常传播和夸大一些人工智慧的进展,喜欢用诸如人工智慧是魔鬼还是天使之类耸人听闻的字眼作为标题。这样的叙事方式也加大了现代人对不断发展的人工智慧的忧虑。

DeepTech:前段时间大火的换脸控制技术,不管是国外的 deepfake 还是国内的 ZAO,都掀起了一阵狂热。你真的现在的这类 AI 应用能在很短的时间里得到广泛的传播,是并非部分因为控制技术发展速度过快、门槛降低?没有约束的科技是危险的,所以如何才能在适度的约束中尽可能地释放控制技术的创新性?伦理伦理与科技政策之间的冲突如果如何协调呢?

帝国豫:我想这类换脸控制技术的迅速传播一方面是因为控制技术本身的门槛比较低,另一方面,也和现代人的好奇心相关。我在朋友圈和微信群中也看到有类似的虽然并非换脸视频,但是一种换脸的 APP,你只要上传一张或是当场拍一张照片后,就可以得到你想要的不同时代、不同形象的照片。我看很多人乐于玩这个游戏,完全是出于好奇心。但可能大部分人都不知道,如此一来,我们的“脸谱”就作为数据被后台保存了下来,这些数据将被如何处理、派作何用我们一般是不知道的,也很少被明确告知。如果这些数据被恶意利用,那将会增添对本人也会对他人和社会的极大的危害。我们知道现在很多银行甚至入户门都是用的人脸来验证人的身份。这些人脸数据就像人的指纹一样,是一个人的重要身份认同的标志。一旦落入不法分子手中,后果不堪设想。

图 | ZAO 海报,ZAO 是一款使用 AI 控制技术完成换脸的应用软件,用户可以上传一张正脸照来

现在的难题是我们在立法和政策规约方面的步伐还有点慢。控制技术创新并不意味着可以为所欲为。控制技术创新的目的是为了美好生活,如果这一创新增添的的社会效益和企业的社会责任。对应的,政府相关部门如果推动相关科学研究,尽快出台相关法律法规,对类似的控制技术进行分类管理,对控制技术创新进行合理引导,而对有些违背了社会公共利益、侵害他人权利的行为坚决制止。

DeepTech:为了尽量使“科技向善”,你真的社会中的不同层级需要做出哪些努力?

帝国豫:按照亚里士多德的说法,每一种技艺都是以某种善为目的的。但是,现代控制技术的一个特点是它的不确定性。这种不确定性贯穿在现代科技从目的到方法和结果的全过程中。面对科技的不确定性,不仅是作为科技工作者和企业有责任,政府的主管部门有责任,人文学者、媒体和公众也承担着一定的责任。

作为从事科技研发的科学家和技师,他们是控制技术的创造者和生产者,最了解控制技术本身的特性和潜在风险,有责任向公众透明地解释和及时通报其潜在的风险和不确定性。科技研发的管理部门和政策决策者,包括政治家和企业家,有责任和科技工作者、人文学者等一起对科技的发展科技发展前沿的社会影响,为政府制定公众可以接受的科技政策提供支持和依据,主流媒体和公共媒体如果深入了解科技本身的特性,而并非以制造新闻为目的。最后,科技的发展离不开公众的支持。公众主动参与科技的社会治理,是确保现代科技向善的一个最重要的力量。

DeepTech:你在今年 CNCC 讨论会上的报告题目是《人工智慧伦理伦理:从几率推断迈向可行性科学研究积极探索》,能否分享一下你选择以此为题的初衷?除了伦理伦理方面的内容之外,此次讨论会还有哪些论坛或是讲者是你比较感兴趣的?

帝国豫:非常感谢讨论会给我这个机会,和大家一起分享我对人工智慧伦理伦理的一点思考。人工智慧伦理伦理属于控制技术伦理伦理的范畴,虽然正如我们前面指出的那样有它特定的地方,但是我指出人工智慧伦理伦理和其它控制技术伦理伦理学的分支一样,我们需要面对的核心难题是人工智慧技术控制系统在安全、自由和公正等方面所增添的不确定性难题。选择这个题目的初衷就是希望能够和大家一起探讨我们如果如何在人工智慧如火如荼进行的同时,找到一条促进人工智慧造福于人类文明,同时又能够有效地避免人工智慧带来的负面后果的方向和方法。

前面我也说到,人工智慧伦理伦理难题的环境治理,既更为重要是伦理政治学家的事,也更为重要是科学家和技师的事,需要更多地交叉学科的合作。在这方面,我们北京大学科技伦理伦理与社会环境治理科学研究中心特别期待向人工智慧专家们学习,与人工智慧专家一起,更加深入地探讨多途径、全方位推动人工智慧伦理伦理难题环境治理的方法与方向。所以,我会在会议期间尽可能地去不同的论坛进行学习。