VR(VR)做为两个基本概念提出已经好久,在各式各样奇幻经典作品中都能看见它的踪迹,但做为真真切切的应用领域,深切的走近现代人的现实生活生活,能说还是两个流行时尚的新事物。

这些年VR(VR)控制技术逐步成形,应用领域情景日渐丰富,开始在方方面面渗入现代人的生活中,但是你真的了解VR吗?它究竟是甚么,能用以做甚么。这一期先试著先期从表述和基本原理方面简单介绍下VR。

一、VR表述

如果身旁人问你甚么是VR,可能绝大多数人能回答”VR”,即使VR全名是Virtual Reality。那甚么是VR,浅显来说就是通过各种控制技术在计算机系统中建立两个真实世界,使用者能沉浸于当中,使用听觉、感官、感官、触觉等感觉来交互那个真实世界,并能与当中的情景、贵重物品、甚至交互式人物形象等进行可视化。

这是我能想到的比较完备的表述,即使它大体上说清楚了VR的三个重要特征:

第一是沉浸于性。

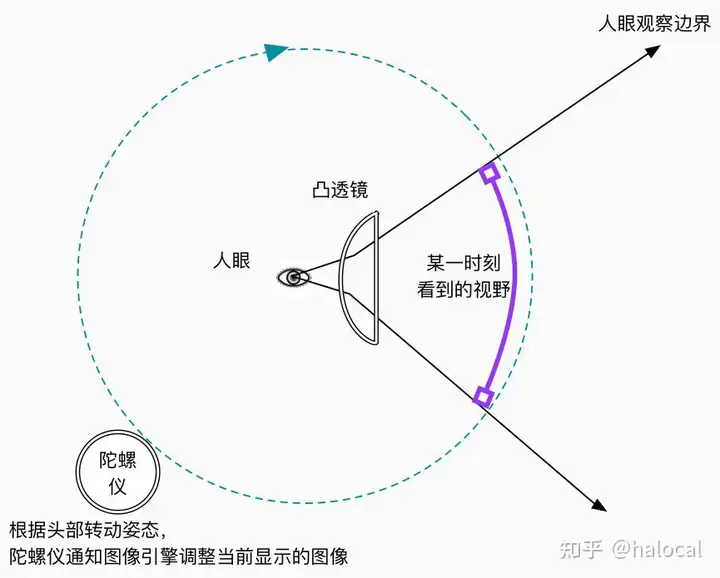

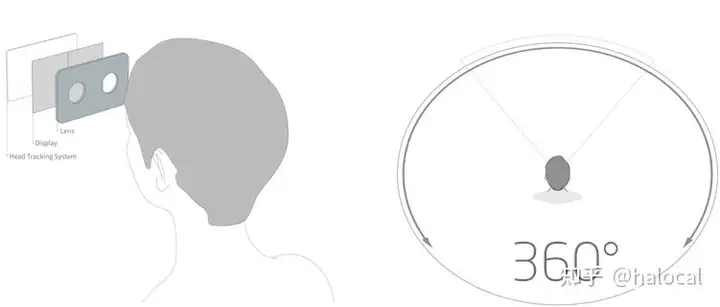

那个优点首先是指使用者所带VRM102z,盖住视野,看不出现实生活世界,只能看见计算机系统聚合的镜头。 其二VRM102z凹透镜弱化可见光看见的即刻影像覆盖范围,造成90~120度覆盖范围视野,这样的视野约莫和三地下通道的球幕二维系统造成的效用相差无几,可见光被阻碍的几率大大增加。

再次M102z中梳钩每两个关键时刻看见的影像是不一样的,从而造成极强的三维夸饰。

另外当人旋转颈部时,M102z上感测器能够及时处理通知影像聚合引擎更新实时镜头,让人感觉自己在看两个环绕的交互式空间,从而造成360度三维空间感。

第二是可视化性。

使用者能够像在现实生活世界中“待人”,“接物”一样,在真实世界中行走、跑、跳、蹲下、站起、抓取、投掷、释放、对话等等。目前VR中一般通过穿戴设备进行可视化。例如手柄、手套、贴片、脑机接口等。也有其他自然可视化方式:例如语言识别、简单的手势识别等。目前VR中的可视化控制技术处在不断探索改进中,可视化起来并不自然。

第三是多交互性。 VR控制技术目标是为了尽可能呈现与现实生活世界一致的感官体验。

听觉:利用逼真的人物形象、贵重物品、情景制作与渲染控制技术,获得以假乱真的听觉体验。

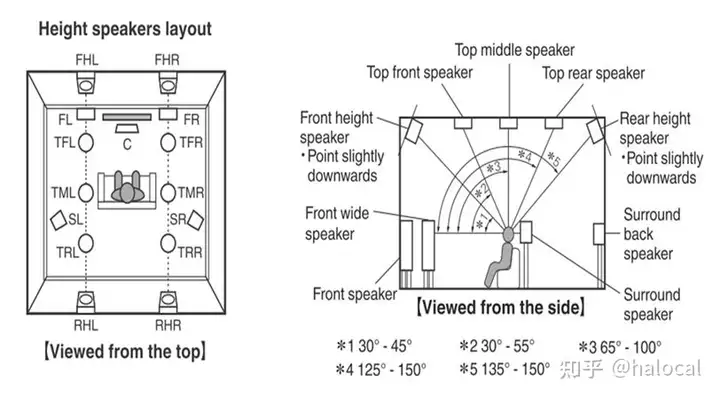

感官:利用声场重建、共振音频等控制技术模拟复杂的空间声场造成与现实生活世界相同的声场效用。

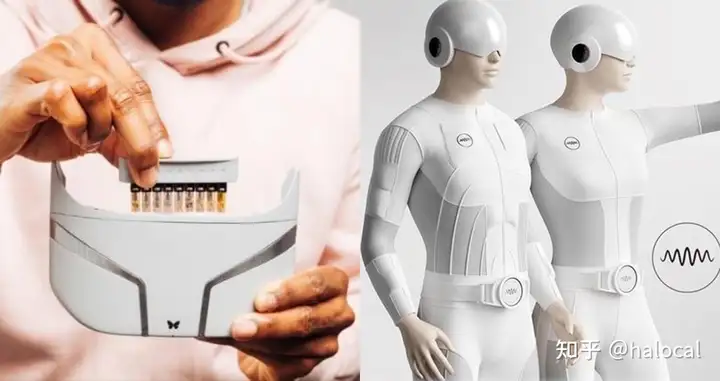

感官:目前主流产品通过手柄震动提供感官反馈。也有一些专业手套设备,通过向手指、手掌施加作用力,提供感官反馈。再比如一些电子皮肤贴片通过振动力度和频率来反馈,还有比如脑机接口使用生物监测以及脑电信号处理控制技术提供免提可视化等。

触觉:目前也有公司和团队在研究VR气味,但在那个维度目前还存在门槛,离在安全的情况下全面拟真还有不小的距离,并在使用者体验上也存在尺度把握和适应性问题。

左侧是 FeelReal VR Mask 气味面具,能外接到头盔上,为某些情景提供气味沉浸于;右侧的 Tesla Suit 触感套装,包括感官反馈、动作捕捉、气候控制和生物反馈系统;它的感官反馈系统基于经皮电神经刺激和电肌肉刺激,借助肌肉电脉冲控制技术,以生物电的形式来将感觉由神经系统传到大脑。那个套装大体上满足了感官反馈的两个维度:力反馈(交互物体形状,重量,硬度等)、触感反馈(交互物体纹理,粗糙度,冷热等),从而使使用者能更加切身的体验真实世界(这些设备目前也普及不了,原因肉眼可见,就不展开说了)。

现在有很多人把VR与3D控制技术混为一谈,把3D电影,3D游戏,3D指挥中心、3D展馆等等都理解为VR应用领域,相信通过以上优点能看出明显的不同了吧。

二、运行基本原理

VR基本概念其实早在1935年小说家温鲍姆的著作《皮格马利翁眼镜》中就已提出,产品也是经过几十年历史一代代人完善与发展,近些年产品迭代速度加快,比较标志性的事件有谷歌2014年推出Cardboard,将VR终端设备小型化,之后三星GearVR、国内暴风魔镜等各式各样眼镜盒子(这些都算不上真正的VR设备),2016年HTC推出划时代的VR设备HTC VIVE,算是先期体验到真实世界,再之后VR设备出现百花齐放的格局,甚么PS VR、RIFT/QUEST、Valve Index、PICO等等。

那么这些VR设备究竟是如何运行的呢,了解它的运行基本原理有助于我们更好的理解VR产品。由于在VR设备是综合运用各式各样控制技术完成交互式内容的呈现,这里简单下描述当中涉及部分内容,后期找时间能对当中主要控制技术展开介绍。

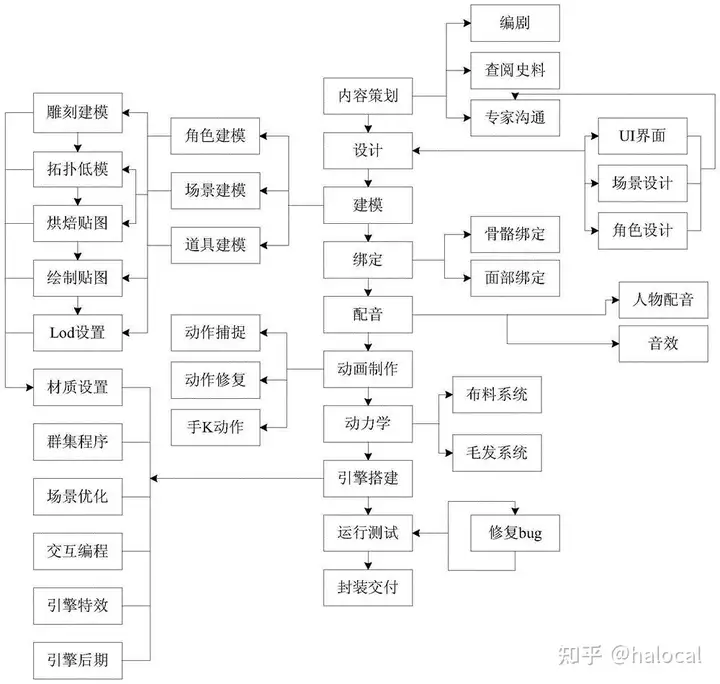

首先是需要制作聚合VR内容,不管是游戏、视频、还是行业应用领域,都是要综合使用各式各样软件工具对VR内容进行调研、分析、设计与开发完成。主要包括:建模、贴图、动画制作、导入开发引擎、音效、图形界面、灯光、特效,编写可视化代码、发布优化等等过程(全景、视频的制作流程不太一样)。

两个典型的VR团队需要内容策划师、美术、建模工程师、音效制作人员、动画师、特效制作人员、开发人员、测试等角色,当中各个角色还能进一步细分,例如建模工程师还能细分为原画设计师、角色设计师、情景师、动漫设计师、UI设计师等等。所以VR内容的制作一般都需要两个团队。每种VR应用领域的开发流程不完全一致,下图举例:VR游戏开发的简要流程。

其二制作好的VR内容在电脑或者一体机上运行起来,需要将每一帧的镜头传输给M102z设备,展示出来,这就需要显示控制技术。

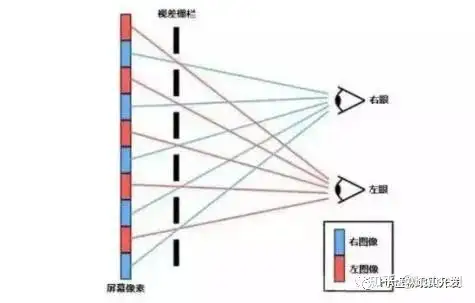

一般VR眼镜为了三维成像,让梳钩看见的影像各自独立分开,并且让梳钩镜头连续交替显示在屏幕,利用可见光听觉暂留生理特征,就能看见三维3D影像。具体需要通过分色、分光、分时、光栅等控制技术,再运用计算机系统图形学对三维成像镜头反畸变、合成、位置预测等处理才能有“真实感”。

为了提高镜头渲染效率,还要引入视点渲染控制技术网络服务器(对于M102z设备只负责展示镜头,不负责计算渲染的情况),那么还需要用到云计算、边缘计算、5G等控制技术。

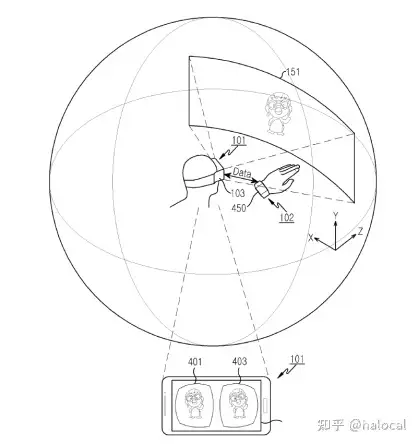

再次当人物形象在交互式情景中移动、旋转、抬头、低头、蹲下、站起等等,计算机系统能够实时精准的根据新的位置信息造成新的镜头,就需要定位追踪控制技术。

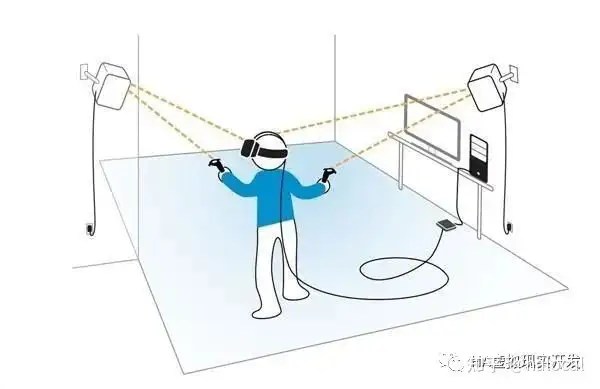

目前主流的两种方式,一种是Outside-In方式,通过基站发射激光定位M102z和手柄上的传感器坐标位置和方向等,并将数据传给计算机系统。计算根据这些数据,判断使用者的姿势,位置等信息,并由此聚合实时镜头。

另一种是Inside-Out方式,主要根据摄像头,传感器(加速计、感测器等)设备数据,综合运行计算机系统听觉,重力、加速度等分析使用者的位置、姿势信息,聚合实时影像(这种方式没有基站定位)。

此外VR设备还需要根据使用者动作指令做出响应,给予镜头反馈,或者给予物理反馈等,这就需要识别控制技术。例如打开门进入新的房间,与角色人物形象招手、凝视,语音发出指令,枪支射击、拉弓射箭,贵重物品拾取等操作需要VR设备识别并反馈。

这里面要综合运用手势识别(主要根据佩戴手套或手柄按键进行硬件检测,也有利用计算机系统听觉算法计算)、语音识别、面部识别(利用面部贴片或听觉计算)、眼动追踪(利用听觉计算、机器学习、眼部肌电信号)、以及感官、触觉反馈等控制技术。

VR设备运行过程中涵盖的控制技术实在太多,对于大部分VR应用领域开发人员来说,其实也用不上这些控制技术,即使设备本身已经为我们屏蔽底层控制技术细节。但了解它的实现基本原理对我们设计出契合的产品,还是有帮助的。