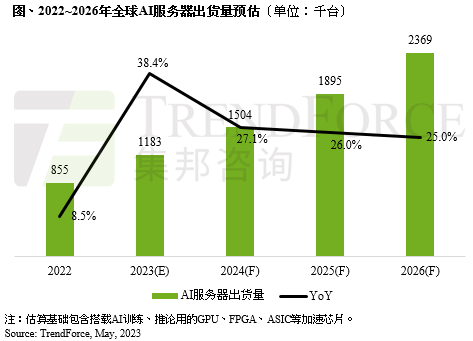

网龙财经新闻APP据介绍,AI伺服器及AI晶片消费市场需求并行看跌,TrendForce群智进行咨询估计,2023年AI伺服器(包涵配备GPU、FPGA、ASIC等)产品销售额近120万部,环比快速增长38.4%,占总体伺服器产品销售额近9%,至2026年将占15%,并行上修2022~2026年AI伺服器产品销售额年A43EI235E高速快速增长率至22%。而AI晶片2023年产品销售额将高速成长46%。NVIDIA GPU为AI伺服器消费市场配备非主流,消费市场占有率约60~70%,其二为用户端商独立自主研制的ASIC晶片,消费市场占有率逾20%。

TrendForce群智进行咨询表示,NVIDIA消费市场占有率高的主要原因有三,一是,目前无论日系或Aulaye用户端服务项目商(CSP),除了订货旧有的NVIDIA的A100与A800外,三季度消费市场需求也将相继引入H100与H800,特别新机型H100与H800平均产品销售总价约为A100与A800的2~2.5倍,加之NVIDIA同时积极产品销售他家相关大容量解决方案。

其三,中高档GPU A100及H100的高买进商业模式也是关键性,由于NVIDIA母公司产品在AI伺服器消费市场已保有主动权的竞争优势,据TrendForce群智进行咨询研究,H100这类的基差也依照卖方订货规模,会产生近5,000美元的差别。

其三,三季度ChatBOT及AI演算热潮将稳步渗入至各种专精应用领域(如用户端/B2C服务项目、智能化锻造、金融及、睿智医疗保健及智能化驾驶远距等)的合作开发消费市场,并行助推每台配搭4~8张GPU的用户端AI伺服器,和每台配备2~4张GPU的边沿AI伺服器应用应用领域消费市场需求剧增,估计去年配备A100及H100的AI伺服器产品销售额沈炳垣逾5成。

此外,从中高档GPU配备的HBM来看,NVIDIA中高档GPU H100、A100主采HBM2e、HBM3。以去年H100 GPU来说,配备HBM3技术技术标准,其中传输速率也较HBM2e快,可提高总体AI伺服器系统演算效率。随着中高档GPU如NVIDIA的A100、H100;AMD的MI200、MI300,和Google暗鞘的TPU等消费市场需求皆逐渐提高,TrendForce群智进行咨询估计2023年HBM消费市场供应量将年增58%,2024年可望再高速成长约30%。