语法处置(NLP)是计算机系统科学应用领域和人工智慧应用领域中的两个分支,它与计算机系统和人类文明之间采用语法进行交互息息相关。NLP的终极目标是使计算机系统能像人类文明一样认知词汇。它是交互式副手、音频辨识、感情预测、自动文档全文、用例等的推动力。在这首诗中,你将自学到语法处置的基本知识,深入了解到它的一些控制技术,了解到NLP如何从广度自学的韦谢列。

1.概要

语法处置(NLP)是计算机系统科学、词汇学和机器。机器自学是受NLP影响最不可估量的应用领域之一,格外突出的是广度自学控制技术。该应用领域分成以下三个部分:

1.音频辨识:将Beckman成文档。

2.语法认知:计算机系统认知人类文明的能力。

3.语法聚合:计算机系统聚合语法。

2.为什么NLP很难

人类文明词汇有其局限性。人类文明词汇专门用于传递发言者和创作者的意思,即使小孩能很快学会,它依然是两个复杂的系统。它的另两个显著之处在于它完全与记号有关。Chris Manning(史丹福教授)表示,它是两个对数的、宗教性的、绝对的讯号系统,这意味着人们能透过采用相同的方式传递相同的涵义,比如说演讲,表情符号,讯号等。人类文明神经系统对这些记号的代码是持续的转化成商业模式,在这个商业模式中,记号透过声音和听觉的连续讯号实现数据传输。

由于其复杂程度,认知人类文明词汇被认为是一项繁重的任务。例如,在语句中排列单字有若干种相同的方式。此外,两个单字能有多种涵义,并且正确说明语句需要正确的情境重要信息。五种词汇或多或少都是独特且模棱两可的。比如说:“The Pope’s baby steps on gays”,这句话显然有三种截然相同的说明,这是反映NLP中的困难之处的两个较好的范例。

随着计算机系统对词汇的认知A45EI321VD轻松,将会造成能处置互联网上全部重要信息的人工智慧(AI),而后造成强人工智慧(AGI)。

3.句法和语法预测

句法预测和语法预测是认知语法的三种主要方式。词汇是几组象征意义的语句,但什么使语句有象征意义呢?实际上,你能将科学性分成两类:句法和语法。名词“句法”是指文档的句法,而名词“语法”是指由它表达的涵义。但,句法上正确的语句不必在语法上正确。只需看看下面的范例。语句“cow kow supremely”在语法上是有效的(主语-动词-副词),但没有任何象征意义。

句法预测:

句法预测,也称为语法预测或解析,是透过遵循正式语法规则来预测语法的过程。语法规则适用于单字和词组,而不是单个单字。语法预测主要为文档分配句法。

语法预测:

我们认知他人的词汇是一种无意识的过程,依赖于直觉和对词汇本身的认识。因此,我们认知词汇的方式很大程度上取决于象征意义和情境。计算机系统却不能依赖上述方式,需要采用相同的途径。 “语义”这个词是两个词汇名词,意思与象征意义或逻辑相近。

因此,语法预测是认知单字、记号和语句结构的涵义和说明的过程,这使计算机系统能以人类文明的方式认知部分涉及象征意义和情境的语法。为什么说只能部分认知呢?是因为语义预测是NLP中最棘手的部分之一,仍未完全解决。例如,音频辨识控制技术已非常成熟,并且工作近乎轻松,但仍然缺乏在语法认知(例如语法)中的熟练程度。手机基本上能认知我们所说的内容,但通常无法用它做任何事情,因为它不了解其背后象征意义。

4.认知文档的技巧

下面我们将讨论多种用于语法处置的现行控制技术。

什么是解析?首先,让我们看一下词典释义:

解析—“将语句分解为其组成部分,并阐述各部分的句法角色。”

实际上解释的已经非常到位,但它能更全面一些。解析是指计算机系统对语句的形式预测,其结果是两个解析树,这个解析树能可视化地显示语句成分之间的句法关系,用于进一步处置和认知。

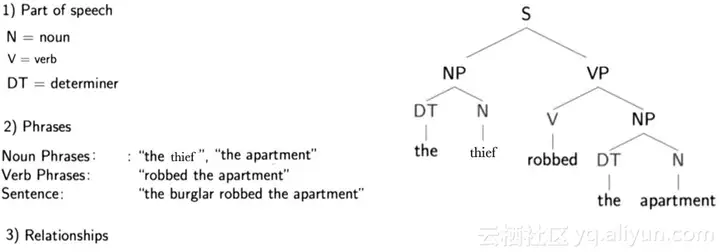

在下面你能看到语句“The thief robbed the apartment”的解析树,以及由它传递的三种相同重要信息类型的描述。

我先看单个单字正上方的字母,它们用于显示每个单字的词性(名词-N,动词-V和限定词-DT)。我们再看解析树中更高的层级,一些单字进行层次分组组成短语。例如,“the thief”是两个名词短语(NP),“robbed the apartment”是两个动词短语(VP),这些短语一起形成两个语句(S),在树中标记在更高的层级。

这些短语以名词为主体,包含两个或多个单字,可能还包含描述性词语、动词或副词,简言之,就是把把名词和与其相关的单字组合在一起。

从解析树中还能看出,单字的表述结构影响其在句中的语法关系。例如,在此结构中,“thief”是“robbed”的主语。

结合结构来看,动词“robbed”,上方标有“V”,更上一级标有“VP”;主语“thief”,上方标有N和“NP”,透过“S”联系在一起。这就像主语—动词关系的模板,同样还有许多其他类型的关系。

词干提取:

词干提取是一种来自形态学和重要信息检索的控制技术,在NLP中用于预处置和效率提升。但,我们首先看一下词典中的释义:词干 — “起源于或由其引起。”

基本上,“词干提取”是将单字进行缩减得到词干的过程,而“词干”的实际象征意义是是在删除单字的所有的前缀后缀之后保留的一部分。例如,“touched”,它的词干是“touch”,同时“touch”也是“touching”等词的词干。

为什么需要词干?因为我们会遇到相同的词汇变形,而实际上它们具有相同的词干和象征意义。举例来说:

# I was taking a ride in the car

# I was riding in the car.

这两个语句意思是一致的,ride和riding的用法也是相同的。

词汇表中所有的单字有相同的注释,其中还包括大量实际象征意义相同的单字,要存储它们,需要两个庞大数据库,但

文字分割:

NLP中的文档分割是将文档转换为有象征意义的单元的过程,能是单字、语句、也能是相同的主题或潜在的意图等。在文档分割中,文档根据相同语种被分割为成份单字,由于人类文明词汇的复杂程度,通常比较难。举个范例,在英语中利用空格来分隔单字,相对高效实用,但也有像“ice box”这类词语的例外,ice和box这两个由空格隔开的词合并一起采用才有原本涵义的,所以人们有时把它写作“ice-box”,那么就给文字分割带来了难题。

命名实体辨识:

命名实体辨识(NER)用于确定文档中哪些词条属于命名实体,这些词条能被定位并归入预定义的类别,类别的范围包括人名,组织,地点,还有货币价值和百分比。

看下面的范例:

NER之前:Martin bought 300 shares of SAP in 2016.

NER之后:[Martin]Person bought 300 shares of [SAP]Organization in [2016]Time.

关系抽取:

关系提取采用“命名实体辨识(NER)”的命名实体,并辨识它们之间的语法关系。这可能意味着它能发现文档中词语之间的关联性,例如谁与谁结婚,某人在哪个公司工作等。这个问题也能转换为分类问题,然后为五种关系类型训练机器自学模型。

感情预测:

透过感情预测,我们想要确定例如说话者或作者关于文档,交互或事件的态度(例如情绪)。因此,需要认知文档以预测潜在意图是一种语法处置问题。情绪主要分成积极,消极和中性两类。透过采用感情预测,我们希望根据他撰写的关于产品的评论来预测客户对产品的看法和态度。因此,感情预测广泛应用于评论,调查,文档等等

如果你对采用Python中的某些控制技术感兴趣,能查看我创建的Python的语法工具包(NLTK)的Jupyter Notebook。你还能查看我的博客文章,了解如何采用Keras构建神经网络,我将训练神经网络进行感情预测。

5.广度自学和NLP

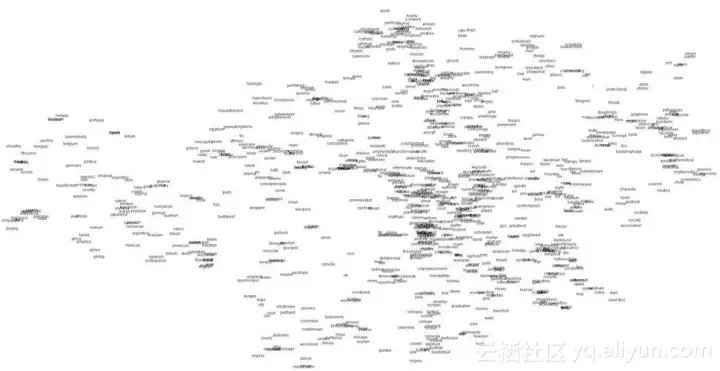

广度自学和语法的核心是“词义”,在这里,单字用两个实数向量来表示。因此,透过向量来代表单字单字,我们能将单字置于高维度的空间中,由向量表示的单字起到语法空间的作用。这仅仅意味着在该高维向量空间中,形近意近的单字倾向于聚集在一起。下图中,能看到单字涵义的直观展示:

在此空间中,如果想要知道某几组聚集成类的单字的涵义,能透过采用主成分预测法(PCA),也能采用降维法。但这些方式太简单并且会遗漏了周边的大量重要信息,因而造成误差。在研究的初始阶段,这些方式较好用,(如数据科学中的逻辑或线性回归)但并不是前沿控制技术。

我们还能将单字的一部分当作向量,这些向量能代表单字的涵义。想象一下“undesirability”这个词。采用“形态学方式”,它涉及两个词所具有的相同部分,我们认为它由词素(单字部分)构成:“Un + desire + able + ity”。每个语素都有自己的向量。这允许我们构建两个神经网络,它能构成两个更大的单位的象征意义,而更大的单位又由所有这些语素组成。

广度自学还能透过创建句法预测器来认知语句的结构,谷歌正在采用这样的依赖解析控制技术,在他们的“McParseface”和“SyntaxNet”(三种词汇解析器),不过更加宏大,更加复杂。

透过预测语句结构,我们开始认知语句的象征意义,能从单字的涵义开始,也能从整个短语和语句开始,无论单字的象征意义、短语还是语句,都用向量来表示。如果想知道语句之间的关系,我们能创建神经网络来帮助预测。

广度自学也适用于感情预测。请看这个电影评论:“这部电影不在乎是不是巧妙,也不在乎幽默与否”。传统的机器自学算法会认为这是两个积极的评论,因为“聪明”和“幽默”是积极的词汇,但神经网络能辨识出它的真正涵义。

另外,广度自学算法实现的用例中,它从语句开始翻译,并聚合两个向量,然后用另外一种词汇聚合所需要的重要信息。

总而言之,NLP与广度自学相结合,就是表示单字、短语的向量,以及它们的涵义。

以上为译文,由阿里云云栖社区组织翻译。

文章原标题《Introduction Into Semantic Modeling for Natural Language Processing》

作者:Aaron Radzinski

译者:Mags,审校:袁虎。

文章为简译,更为详细的内容,请查看原文

阿里云云栖社区 – 知乎

本文为云栖社区原创内容,未经允许不得转载。