2020年8月29日,sert·特斯拉(Elon Musk)在加利福尼亚州贝特贝尔纳举行了一场发布会,正式向全世界展示了自己的虚拟实境自然科学公司Neuralink对猪进行虚拟实境USB

控制技术的成果,该晶片能实时监测到毛毛的脑电讯号,遗憾的是我们还无法知道毛毛在想什么,但这项控制技术所揭示的今后太令人期待了,这则报道迅速轰动世界也是现代人内心偏好的真实反映,它重新激发了现代人对于虚拟实境USB控制技术(brain-computer interface,BCI)的热情。

所谓的虚拟实境USB,通俗而言是在大脑(或动物)与输入输出之间建立直接的联系,由此形成讯号的接收与推送,并同时实现相应的机能。按照虚拟实境接入的方式能分为两类:入侵式虚拟实境USB(特斯拉这次模拟的就属于此类)或非入侵式虚拟实境USB。前者的优点在于获得的脑电信号更快,便于分析与处理,而后者收集到的讯号质量较差、容易受到噪声干扰。因此,入侵式虚拟实境USB是目前国际学术的前沿。虚拟实境USB早已实实在在地出现在我们的面前,随著置入头脑的各类晶片与传感器的日渐新兹、机能网络化、加上近年来人类文明对神经系统机能了解的深入、虚拟实境融合的逐步完善、皮下的微小化、和电池机能的进一步增强,虚拟实境USB控制技术取得重大成果绝非幻想,而是一种能预见获得的行业发展趋势。

现代人之所以对虚拟实境USB控制技术的行业发展趋势持乐观态度,是因为社会上对于虚拟实境USB控制技术有着巨大的市场需求,它所拥有的潜在品牌价值是推动此项控制技术发展的重要动因。仅就目前能想象获得应用来看,虚拟实境USB发展前景广阔,前述四种情况是最有可能协同发展的领域,如果此项控制技术成熟,所以日渐困扰老年人的帕金森氏症现象将获得极大缓解;修复伤残病人的神经系统缺陷,从而同时实现部份皮肤机能的恢复,和能实现化疗抑郁症等精神疾病;什至能同时实现神经进一步增强机能,如神经系统的反应速度与梦境潜能都是远蜘蛛人类文明的,如果今后置入的晶片与神经系统更快地相容,所以人类文明的反应速度与梦境潜能都将获得根本性的改变,锻造蜘蛛人不再是梦想。上述四种情况在自然科学上几乎都有获得成功案例。如对伤残人而言,通过想像力同时实现部份皮肤机能,这类实验获得成功的很多,如早已被广泛采用的脑aromatic电刺激控制技术,这是赫赫有名的“脑心脏起搏器”,其原理是通过置入脑组织的阴极向神经系统的特定部位推送电信号,这一控制技术主要用作化疗利血平和潜在性精神疾病等疾病,早已被美国食品药监局批准。

再比如,美国著名的听觉虚拟实境USB专家都米济(William Dobelle,1941-2004),他的皮质听觉虚拟实境USB主要用作后天失聪的病人。1978年,都米济在一位男性盲人迈克(Jerry)的听觉皮质置入了68个阴极的侦测器,并获得成功锻造了光阿宝(Phosphene)。置入后病人能看见对比度和更新率较高的图像。如果说都米济的工作是40年前控制技术的体现,所以现在这方面的研究也有了韦谢列,失聪病人看见的视野比以前要好许多,有理由预测,随著一些关键难题的突破,听觉虚拟实境USB将造福更多的失聪病人。

还有自然科学家把人造海马体置入到因海马体受损而丧失梦境形成机能的老鼠脑中,并获得成功让老鼠恢复了部份梦境形成机能(伯杰等人)。基于上述案例,我们大体上能清晰判断出虚拟实境USB控制技术正在向日常生活领域扩散,一旦有控制技术上的突破,这种趋势将无可逆转。

问题是虚拟实境USB控制技术虽然具有如此广阔的应用前景,但也不可避免地带来某些人类文明从来没有遭遇过的伦理困境。对此,瑞典数学家奥勒•哈格斯特姆曾指出,虚拟实境USB控制技术带来的两种常见的伦理问题是:隐私和认知潜能的“军备竞赛”。关于隐私问题,这早已成为高科技时代具有普遍性的伦理困境,每一次控制技术升级,都会导致隐私状态随之发生改变,从人类文明历史上看,从农业社会、工业社会到后工业社会,人类文明的隐私范围是逐渐缩小的。总体而言,控制技术进步导致公共领域扩张,而私人领域日渐被控制技术侵蚀,隐私也随之日渐变小,人变成了透明人,隐私的消失也就意味着个人自由的萎缩。对于虚拟实境USB控制技术而言,这种情况尤为紧迫。一旦通过家对于全民的监视等。这种过程是渐进的,在温水煮青蛙效应中,人类文明的隐私一点点失去,我们不知道这是否是人类文明为控制技术进步所必须付出的代价。上述担忧绝非杞人忧天,据资料介绍,1999年斯坦利(Garrett Stanley,现在埃默里大学Emory University任职)教授,在哈佛大学通过解码猫的丘脑外侧膝状体内的神经元放电信息来重建听觉图像。他们记录了177个神经元的脉冲列,使用滤波的方法重建了向猫播放的八段视频,从重建的结果中能看见可辨认的物体和场景。同理,利用这套控制技术也能重建人类文明的听觉内容。看见这类实验,你还认为虚拟实境USB所引发的隐私问题还很遥远吗?更何况遥远并不意味着不可能。

再而言说由虚拟实境USB所带来的认知潜能的“军备竞赛”问题。由于电脑在精确计算、数据传输与梦境方面比人类文明的表现强很多,所以,随著控制技术的发展与完善,总会有一些人尝试在神经系统中置入一些晶片,使自己的潜能与计算机的潜能进行整合,这将造就认知蜘蛛人,试问我们正常人再怎么努力也无法达到电脑所具有的梦境潜能,这种事情一旦开始就无法停下来,从而陷入“军备竞赛”的游戏框架下,因为没有人敢于停下来,否则他将被淘汰。问题是这种神经进一步增强完全打破了人类文明由自然选择以来所形成的所有关于公平的规范?此时优秀将不再是对于人的潜能的褒奖,而是对他置入神经系统的设备的褒奖?所以人类文明的价值又何在呢?也许影响更为深远的是,虚拟实境USB控制技术的军备竞赛式滥用,还会

以虚拟实境USB控制技术为标志的人工智能发展引发出一系列我们目前尚无法完全预料到的后果,它事关人类文明的今后,因此,必须从伦理层面对于它的发展进行有目的的约束。2020年上半年,美国五角大楼正式公布人工智慧的五大伦理原则,即负责、公平、可追踪、可靠和可控。这个说法作为伦理原则没有错,但是如何在实践中落实,仍存在很多不明确之处,为此,我们需要构建一套全流程的伦理规范机制,把伦理责任分解,采取分布式伦理,即人工智慧从锻造到应用每个环节都承担相应的伦理责任,只有这样,人工智慧才能最大限度上既增进社会的福祉,又把其潜在的风险最小化。目前的调查与研究显示,在新控制技术发展的进程中,每个人的责任都是有限的,但是其后果却是严重的。由于人类文明对于微小的恶的不敏感性,导致最初对于风险呈现出整体的麻木状态,到后来小风险的累积就成为高科技面临的严重伦理问题。这已成为一种风险扩散的普遍模式,为此,我们需要构建一个新的伦理责任体系。

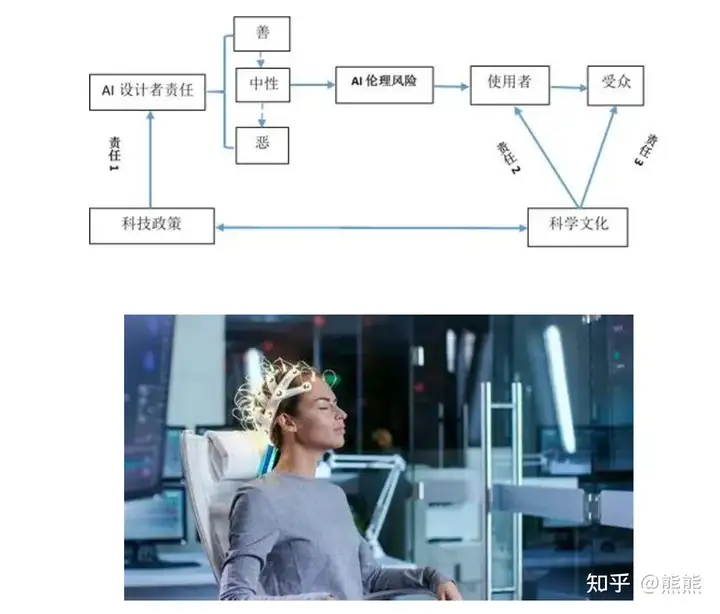

由于人工智慧本身的复杂性,以及今后发展的不确定性,导致人工智慧责任的明确归属变得更为困难和模糊,如何防范其可能带来的风险也就变得越发困难,甚至会出现无法追责的伦理缺席现象。因此,传统的针对单一主体的伦理规范原则开始失灵,为此我们必须构建一种新的伦理约束机制,从而同时实现对人工智慧从前端、中端到末端全覆盖的有效伦理风险防范机制。为此,我们借用英国伦理学家卢恰诺•弗洛里迪提出的分布式道德概念构建人工智慧的伦理风险防范框架示意图,根据这张框架图我们能把人工智慧伦理风险防范分为三部份:首先,是前端的AI设计者的伦理责任(责任1,简称R1),其次,是中端使用者的伦理责任(责任2 ,简称R2),第三,是末端受众的责任(责任3,简称R3)。

我们不妨假设人工智慧所引发的伦理风险总量用公式表示为:ΣR=R1+R2+R3,其中,R1≥R2≥R3。这三段式伦理分布的规约机制分别是:1、对于设计者而言,他有多种动机(从善、中性到恶的选择),这一部份伦理风险要通过具有强制性的政策手段(严重违规就上升到法律规约)来遏制,所有负责任创新都是从动机上防范伦理风险的发生;2、对于使用者而言,他要为自己的使用承担相应的伦理责任;3、受众作为社会成员,有监督人工智慧使用的间接责任(个体责任最小,但是由于公众数量庞大,无数微小的努力汇聚起来是强大的伦理风险防范力量),2与3的激活需要利用自然科学文化的规训作用,在高科技时代没有人是旁观者,只有伦理责任的全覆盖,高科技的伦理风险才会被最大限度上遏制,具体内涵见下图: